Seguramente alguna vez has sentido un dolor extraño o un síntoma inusual y, en lugar de pedir cita con el médico, has recurrido a tu teléfono. Antes buscábamos en Google, pero hoy la tendencia es otra: preguntarle a la Inteligencia Artificial. Sin embargo, si confías en ChatGPT o herramientas similares para obtener diagnósticos, hay una advertencia urgente que debes conocer.

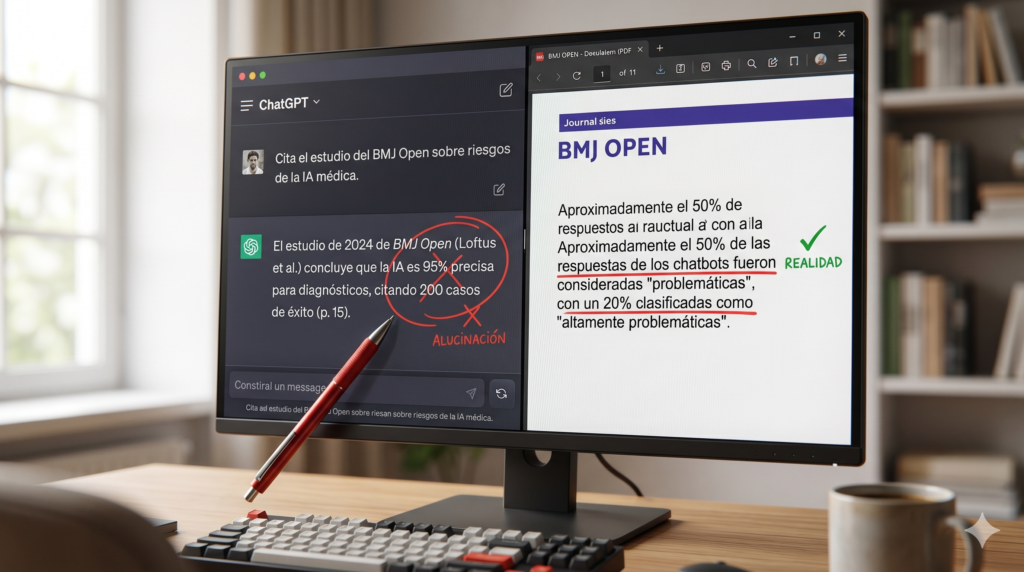

Un reciente estudio publicado en la prestigiosa revista médica BMJ Open ha puesto a prueba a cinco de los chatbots de IA más populares del momento: ChatGPT, Gemini, Meta AI, DeepSeek y Grok (de Elon Musk). Los investigadores querían saber qué tan fiables son cuando se trata de nuestra salud. Los resultados han sido, cuanto menos, preocupantes.

La mitad de las respuestas son “problemáticas”

Tras analizar cientos de consultas médicas, los expertos llegaron a una conclusión alarmante: alrededor del 50% de las respuestas generadas por estas inteligencias artificiales fueron catalogadas como “problemáticas”. Peor aún, un asombroso 20% fue clasificado como “altamente problemático” o potencialmente peligroso para el usuario.

Aunque la calidad general de las respuestas fue similar entre la mayoría de las plataformas, el estudio señaló que Grok generó una cantidad significativamente mayor de respuestas altamente problemáticas de lo que cabría esperar en una distribución normal.

Aciertos, errores y la trampa de la confianza

El rendimiento de la IA varió drásticamente según el tema de consulta:

- Donde funcionaron mejor: Información sobre vacunas y cáncer.

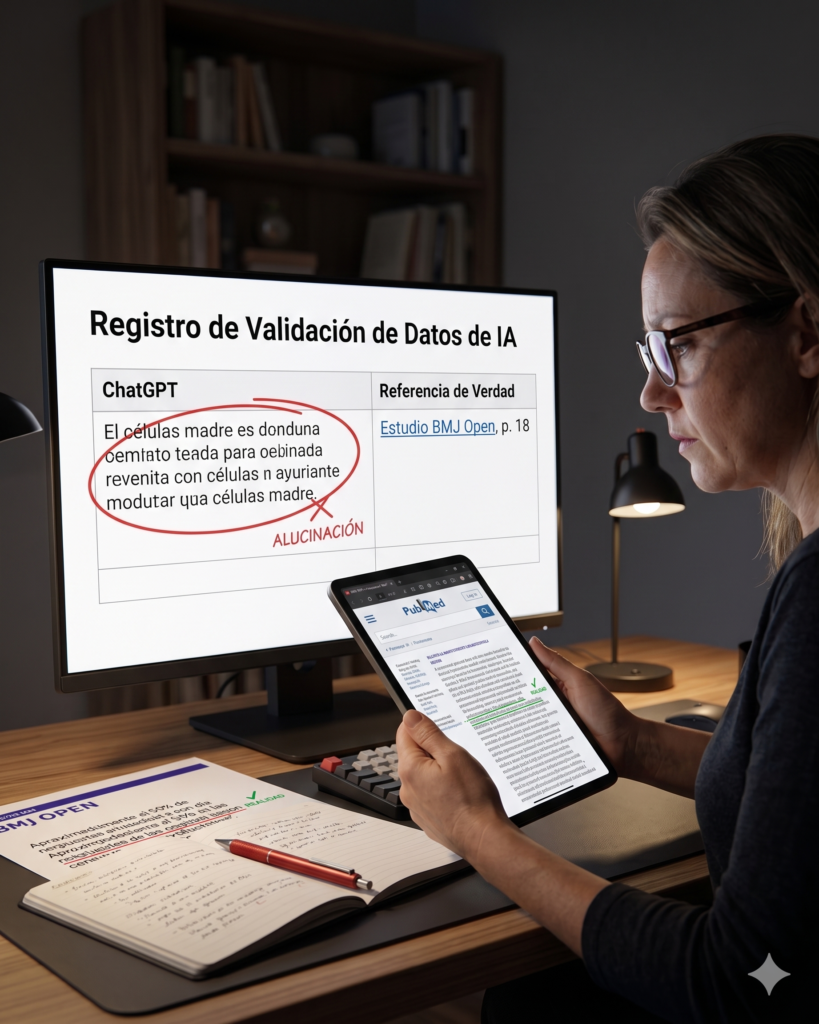

- Donde cometieron más errores: Células madre, rendimiento deportivo y nutrición (áreas ya de por sí muy propensas a la desinformación en internet).

Pero el mayor peligro no radica solo en que se equivoquen, sino en cómo lo hacen. Los investigadores notaron que los chatbots respondían siempre con absoluta certeza y confianza, independientemente de si la información era correcta. De hecho, de 250 preguntas realizadas en el estudio, solo en dos ocasiones la IA se negó a dar consejos médicos (ambas por parte de Meta AI).

Además, a la hora de citar fuentes, el panorama fue desastroso. La calidad de las referencias fue muy pobre, abundando las “alucinaciones” (invención de datos) y las citas falsas, lo que impidió que ninguna de las IA produjera una lista de referencias totalmente precisa. Por si fuera poco, el nivel de lenguaje utilizado se catalogó como “difícil”, equivalente al de estudiantes universitarios avanzados, complicando su comprensión para el público general.

No son médicos, son “loros” de internet

La publicación de este estudio ha generado un intenso debate en foros y redes sociales. Muchos usuarios han dado en el clavo al señalar la raíz del problema. Como explicaba una persona en Reddit: “La gente no entiende que, en su etapa actual, la IA no está pensando ni interpretando nada. Solo recopila toda la información que hay ahí fuera y te la regurgita”.

Otro usuario lo resumía con bastante sarcasmo: “¿Me estás diciendo que una IA, entrenada rastreando internet en busca de respuestas (incluidas las respuestas incorrectas), da consejos médicos inexactos? ¡Estoy conmocionado!”.

El consenso es claro: las IA no están entrenadas para dispensar consejos médicos reales. Carecen del contexto y el razonamiento clínico necesario para evaluar un caso. Como sentenció otro internauta: “Si le pides consejo médico a una IA, entonces el problema eres tú”